Zgodnie z powszechną mądrością: „Jeśli nie chcesz, aby Twoje dane były wykorzystywane, wycofaj się ze wszystkiego”.

My mówimy: „Jeśli Twoje dane są i tak gromadzone, bardziej racjonalne jest wywieranie wpływu na sposób ich wykorzystania”.

Nie chodzi o to, czy „firmy powinny mieć moje dane” (bo już je mają).

Prawdziwe pytanie brzmi: „Czy moje dane powinny przyczyniać się do tworzenia lepszej sztucznej inteligencji dla wszystkich?”.

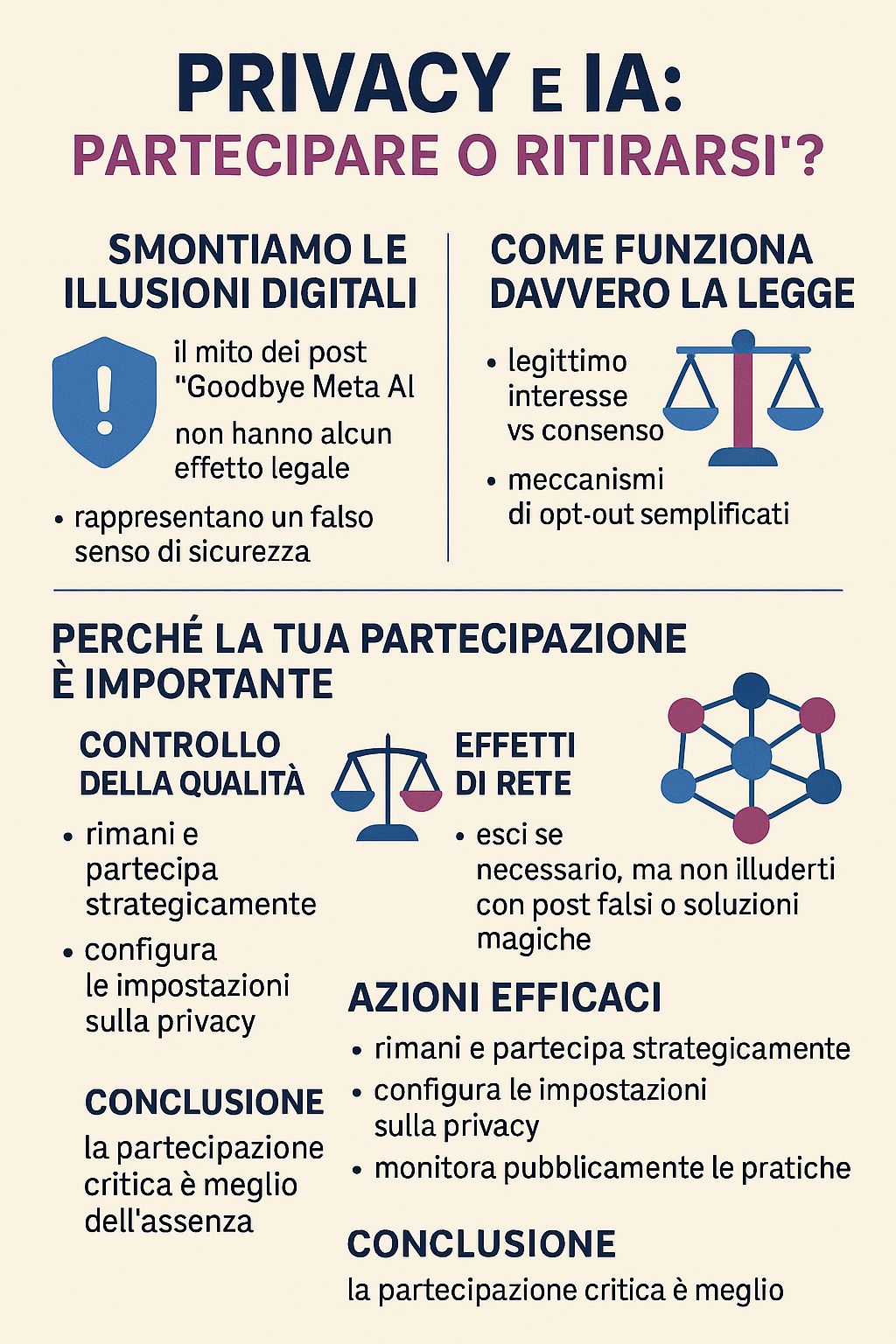

Przed sformułowaniem poważnej argumentacji należy obalić niebezpieczną iluzję krążącą w mediach społecznościowych: wirusowe posty „Goodbye Meta AI”, które obiecują ochronę danych użytkownika poprzez zwykłe udostępnienie wiadomości.

Niewygodna prawda: te posty są całkowicie fałszywe i mogą sprawić, że staniesz się bardziej podatny na zagrożenia.

Jak wyjaśniła sama Meta, „udostępnianie wiadomości „Goodbye Meta AI” nie stanowi ważnej formy sprzeciwu”. Te posty:

Wirusowy sukces tych postów ujawnia głębszy problem: wolimy proste i iluzoryczne rozwiązania od złożonych i świadomych decyzji. Udostępnianie postów sprawia, że czujemy się aktywni, nie wymagając od nas wysiłku, aby naprawdę zrozumieć, jak działają nasze prawa cyfrowe.

Ale prywatności nie broni się memami. Broni się ją wiedzą i świadomym działaniem.

Od 31 maja 2025 r. Meta wdrożyła nowy system szkolenia sztucznej inteligencji, wykorzystując jako podstawę prawną „uzasadniony interes” zamiast zgody. Nie jest to luka prawna, ale narzędzie prawne przewidziane w RODO.

Uzasadniony interes pozwala firmom przetwarzać dane bez wyraźnej zgody, jeśli mogą wykazać, że ich interes nie ma pierwszeństwa przed prawami użytkownika. Tworzy to szarą strefę, w której firmy „dostosowują prawo do swoich potrzeb” poprzez wewnętrzne oceny.

Wykorzystanie danych nieanonimowych wiąże się z „wysokim ryzykiem odwrócenia modelu, wycieków pamięciowych i podatności na ekstrakcję”. Niezbędna moc obliczeniowa oznacza, że tylko podmioty o bardzo dużej wydajności mogą skutecznie wykorzystywać te dane, co powoduje asymetrię systemową między obywatelami a dużymi korporacjami.

Teraz, gdy wyjaśniliśmy kwestie prawne i techniczne, przejdźmy do argumentów przemawiających za strategicznym udziałem.

Kiedy świadomi ludzie rezygnują, sztuczna inteligencja trenuje na tych, którzy pozostają. Czy chcesz, aby systemy sztucznej inteligencji opierały się głównie na danych osób, które:

Uprzedzenia w sztucznej inteligencji pojawiają się, gdy dane szkoleniowe nie są reprezentatywne. Twój udział pomaga zapewnić:

Systemy sztucznej inteligencji poprawiają się wraz ze skalą i różnorodnością:

Jeśli korzystasz z funkcji opartych na sztucznej inteligencji (wyszukiwanie, tłumaczenie, porady, narzędzia ułatwień dostępu), Twoje zaangażowanie przyczynia się do ich ulepszania dla wszystkich, w tym przyszłych użytkowników, którzy najbardziej ich potrzebują.

Twoja prywatność nie ulega znaczącej zmianie między opcją opt-in a opt-out dla sztucznej inteligencji. Te same dane są już wykorzystywane:

Różnica polega na tym, czy dane te przyczyniają się również do ulepszenia sztucznej inteligencji dla wszystkich, czy też służą wyłącznie bieżącym interesom komercyjnym platformy.

Właśnie dlatego osoby odpowiedzialne, takie jak Ty, powinny się zaangażować. Wycofanie się nie powstrzyma rozwoju sztucznej inteligencji, a jedynie pozbawi Cię możliwości wyrażenia swojego zdania.

Systemy sztucznej inteligencji i tak zostaną opracowane. Pytanie brzmi: czy z udziałem osób krytycznie podchodzących do tych kwestii, czy bez nich?

To zrozumiałe. Ale zastanów się nad tym: czy wolałbyś, aby systemy sztucznej inteligencji były tworzone z udziałem osób podzielających Twoje sceptyczne podejście do wielkich korporacji, czy też bez takiego udziału?

Twoja nieufność jest właśnie powodem, dla którego Twoje krytyczne zaangażowanie jest tak cenne.

Sztuczna inteligencja staje się rzeczywistością, niezależnie od tego, czy bierzesz w tym udział, czy nie.

Nie decydujesz o tym, czy sztuczna inteligencja zostanie stworzona, ale czy ta sztuczna inteligencja będzie odzwierciedlać wartości i perspektywy osób, które dokładnie zastanawiają się nad tymi kwestiami.

Rezygnacja z udziału w wyborach jest jak niegłosowanie. Nie powstrzymuje to wyborów, oznacza jedynie, że wynik nie uwzględni Twojego wkładu.

W świecie, w którym tylko podmioty dysponujące bardzo dużą mocą obliczeniową mogą skutecznie interpretować i wykorzystywać te dane, Twój krytyczny głos w procesie szkolenia może mieć większy wpływ niż Twoja nieobecność.

Zostań i działaj strategicznie, jeśli:

A w międzyczasie:

Ale nie łudź się:

Twoja indywidualna rezygnacja ma minimalny wpływ na Twoją prywatność, ale pozostanie ma realny wpływ na wszystkich.

W świecie, w którym systemy sztucznej inteligencji będą determinować przepływ informacji, decyzje i interakcje między ludźmi a technologią, nie chodzi o to, czy systemy te powinny istnieć, ale czy powinny uwzględniać punkt widzenia osób refleksyjnych i krytycznych, takich jak Ty.

Czasami najbardziej radykalnym działaniem nie jest rezygnacja. Często najbardziej radykalnym działaniem jest pozostanie i upewnienie się, że nasz głos zostanie wysłuchany.

Anonimowy

Nie chodzi o ślepe zaufanie do firm lub ignorowanie obaw związanych z prywatnością. Chodzi o uznanie, że prywatności nie broni się memami, ale strategicznym i świadomym zaangażowaniem.

W ekosystemie, w którym asymetrie władzy są ogromne, Twój krytyczny głos w szkoleniu sztucznej inteligencji może mieć większy wpływ niż Twoja protestacyjna nieobecność.

Niezależnie od tego, jaki wybór podejmiesz, dokonaj go świadomie, a nie w oparciu o cyfrowe iluzje.

Warto również wspomnieć o „pustelnikach prywatności” – tych czystych duszach, które wierzą, że mogą całkowicie uniknąć cyfrowego śledzenia, żyjąc offline jak tybetańscy mnisi w 2025 roku.

Spoiler: nawet jeśli zamieszkasz w odległej chatce w Dolomitach, Twoje dane są już wszędzie. Twój lekarz rodzinny korzysta z systemów cyfrowych. Bank, w którym trzymasz oszczędności na zakup drewna opałowego, śledzi każdą transakcję. Supermarket w miejscowości posiada kamery i systemy płatności elektronicznych. Nawet listonosz, który dostarcza Ci rachunki, przyczynia się do tworzenia zbiorów danych logistycznych, które zasilają algorytmy optymalizacyjne.

Całkowite wycofanie się z cyfrowego świata w 2025 r. oznacza w zasadzie wykluczenie się ze społeczeństwa obywatelskiego. Można zrezygnować z Instagrama, ale nie można zrezygnować z systemu opieki zdrowotnej, bankowości, edukacji czy pracy bez dramatycznych konsekwencji dla jakości życia.

A kiedy budujesz swoją chatę chroniącą przed 5G, Twoje dane nadal istnieją w bazach danych szpitali, banków, ubezpieczycieli, gmin, urzędów skarbowych i są wykorzystywane do szkolenia systemów, które będą miały wpływ na przyszłe pokolenia.

Paradoks pustelnika: Twoja izolacja nie zapobiega szkoleniu systemów sztucznej inteligencji na danych osób mniej świadomych, ale pozbawia Cię możliwości wpływania na ich rozwój w kierunku bardziej etycznym.

W zasadzie zdobyłeś nieskażoną moralną czystość kogoś, kto obserwuje historię z trybun, podczas gdy inni – mniej oświeceni, ale bardziej obecni – piszą zasady gry.

Niezależnie od tego, jaki wybór podejmiesz, dokonaj go świadomie, a nie w oparciu o cyfrowe iluzje.

Cytowane artykuły:

Więcej informacji na temat RODO i prawnie uzasadnionego interesu:

Oficjalne źródła:

Konkretne działania: jeśli mieszkasz w Europie, sprawdź oficjalne procedury rezygnacji w Garante Privacy. Ogólne informacje znajdziesz w ustawieniach prywatności i warunkach korzystania z platformy. Pamiętaj: żadne posty w mediach społecznościowych nie mają mocy prawnej.